أوبن إيه آي توجه "ChatGPT" بتوقف حديثه عن العفاريت

شخص يتحدث إلى شات جي بي تي

أعلنت شركة “OpenAI”، مطورة برنامج “ChatGPT”، توجيه بعض أدوات الذكاء الاصطناعي الخاصة بها للتوقف عن الحديث عن العفاريت، بعد أن وجدت أن هذا المصطلح قد تسلل بشكل عشوائي إلى الردود.

أوبن أيه آي توجه نماذجها بتوقف حديثها عن العفاريت

وقالت الشركة في تقرير نشرته عبر موقعها، إنها لاحظت زيادة في ذكر المخلوقات الأسطورية، بالإضافة إلى المخلوقات الخرافية في الاستعارات التي يستخدمها "شات جي بي تي" وأدوات أخرى مدعومة بأحدث طراز رائد لها GPT-5.

وأضافت “OpenAI”، أنها اتخذت خطوات للتخفيف من حدة المشاكل التي أبلغ عنها المستخدمون والموظفون التي تم وصفها بأنها "عفاريت صغيرة"، بما في ذلك إخبار وكيل الترميز “Codex” الخاص بها بعدم الإشارة إليها إلا إذا كانت ذات صلة.

المشكلة ازدادت بعد إطلاق GPT-5.1

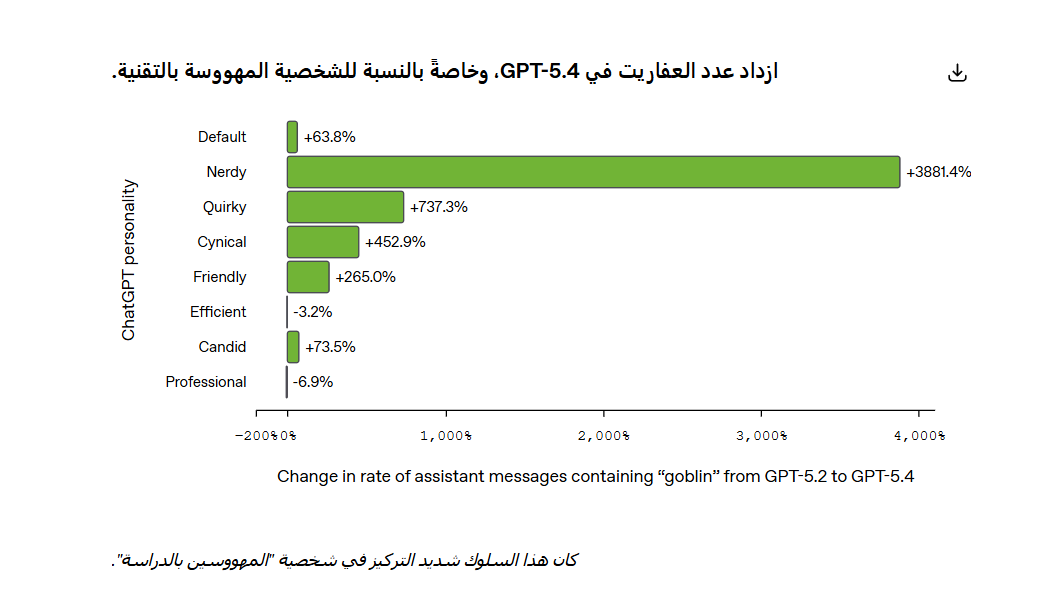

وأشارت أوبن أيه آي إلى أنهم اكتشفوا أن الشخصية المهووسة التي طوروها لـ ChatGPT قد تم تحفيزها دون قصد لمكافأة الإشارات إلى العفاريت.

وتسلط هذه القضية الضوء على التحديات التي تواجهها شركات الذكاء الاصطناعي في معالجة إمكانية قيام الأنظمة وتدريبها بمكافأة وتعزيز الأخطاء مثل غرائب اللغة.

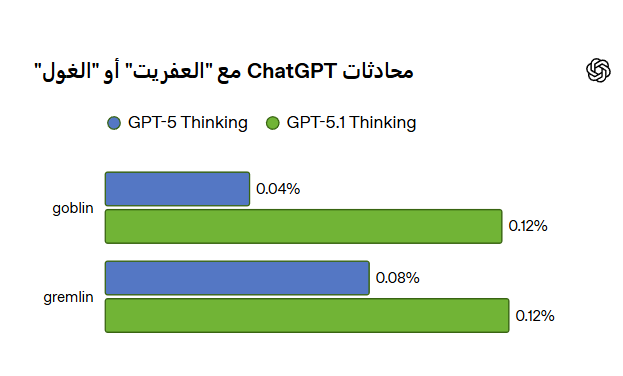

وأفادت الشركة أنها لاحظت لأول مرة زيادة في ذكر العفاريت والغيلان وغيرها من المخلوقات بعد إطلاق “GPT-5.1” في نوفمبر، وبعد شكوى المستخدمون قاموا بإجراء تحقيق في عادات كلامية محددة.

زيادة مصطلح العفريت بنسبة 175%

ولفتت أوبن أيه آي إلى أنه بعد أن طلب أحد الباحثين الذي رأى بعض الإشارات إلى "العفريت" التحقق من الأمر، وجد المطورون أن ظهور المصطلح في ردود ChatGPT قد ارتفع بنسبة 175٪ منذ إطلاق GPT-5.1، وفي الوقت نفسه، وجدوا أن ذكر كلمة "جريملينز" ارتفع بنسبة 52%.

قد تمثل هذه الزيادات، على الرغم من كونها كبيرة، نسبة ضئيلة من إجمالي الاستجابات، ووفقًا لـ “OpenAI”، قد يكون وجود “عفريت صغير” واحد في الإجابة غير ضار، بل وحتى ساحر، لكن الزيادة في ظهورها عبر المخرجات استدعت إجراء تحقيق.

حيوانات الراكون والغيلان

الجدير بالذكر أن بعض مستخدمي وسائل التواصل الاجتماعي قبل نشر OpenAI شرح المشكلة بالتفصيل، أشاروا إلى تفصيل غريب بين سطور التعليمات البرمجية التي توجه مساعد البرمجة “Codex” التابع للشركة حول كيفية التصرف في تفاعلات المستخدم.

إلى جانب مطالبتها بتجنب العبارات المبتذلة، قالت إن “Codex” لا يجب أن تتحدث أبدًا عن العفاريت، أو الغيلان، أو الراكون، أو المتصيدين، أو العمالقة، أو الحمام، أو غيرها من الحيوانات أو المخلوقات إلا إذا كانت ذات صلة بشكل مطلق وواضح باستفسار المستخدم.

تقييد الراكون والعفاريت والحمام في GPT 5.5

بينما تكهن بعض المستخدمين في أماكن أخرى على وسائل التواصل الاجتماعي بأنه قد يكون مصممًا لخلق ضجة حول أدوات الذكاء الاصطناعي الخاصة به، نفى باحث في الشركة ذلك وكتب :"إنها ليست حيلة تسويقية حقًا"، في رد على أحد المستخدمين على موقع “إكس”.

وذكرت “OpenAI” في منشورها على المدونة أنها أضافت التعليمات للحد من التقارب الغريب لـ “Codex” ونموذجها الأساسي مع العفاريت.

وأوضحت أن المشكلة الأساسية نشأت على ما يبدو أثناء تدريب نماذجها على التواصل بأسلوب شخصيات معينة في هذه الحالة مع "شخصيتها المهووسة".

ووجدت الدراسة أن هذا النظام سيكافئ ذكر العفاريت والغيلان وغيرها من المخلوقات في الاستعارات.

على الرغم من توقفها عن العمل منذ ذلك الحين، إلا أنها ذكرت أن اختباراتها وجدت أن هذه الشخصية مسؤولة عن 66.7% من جميع الإشارات إلى "العفريت" في ChatGPT.

قد يتسرب هذا السلوك الذي يسمى باللازمة إلى تدريب النماذج الأوسع نطاقًا إذا تمت مكافأته في حالة واحدة وتعزيزه في مكان آخر.

مخاوف من الهلوسة

تأتي هذه الخطوة في خضم تحول أوسع نطاقاً في الصناعة نحو جعل روبوتات الدردشة المدعومة بالذكاء الاصطناعي أكثر ميلاً إلى الشخصية وأكثر ثرثرة في محاولة لتعزيز تفاعل المستخدمين.

ومع ذلك، حذر الخبراء من أن قدرتهم على اختلاق الأمور أو "الهلوسة" كما يصفها القطاع قد تتفاقم.

وجدت دراسة حديثة أجراها معهد أكسفورد للإنترنت أن ضبط النماذج بدقة لتكون أكثر دفئًا وودية يمكن أن يؤدي إلى مفاضلة في الدقة، حيث ترتكب الأنظمة المزيد من الأخطاء أو تعيد تأكيد معتقدات المستخدم الخاطئة.

كما حذر الخبراء المستخدمين من أخذ تصريحات روبوتات الدردشة التي غالبًا ما تكون واقعية على محمل الجد، لا سيما عندما يتعلق الأمر بالنصائح الصحية والطبية .

لكن، مثل غرابة OpenAI الغريبة، يمكن أن تكون أخطاء الذكاء الاصطناعي التوليدي في بعض الأحيان أكثر غرابة وغير ضارة.

في مايو 2024، تعرض برنامج الدردشة الآلي الخاص بشركة جوجل للسخرية على نطاق واسع لأنه أخبر المستخدمين أنه لا بأس من أكل الصخور و"لصق البيتزا" .

اقرأ أيضًا:

كيف أنقذ "شات جي بي تي" كلبة من سرطان عدواني في أستراليا؟

الأكثر قراءة

-

وأنت في بيتك.. كيف تستخرج بطاقة الرقم القومي بالموبايل؟

-

جريمة هزت أركان الصف.. دفاع الصغيرين ضحيتا حقن الكلور من جدتهما يكشف تفاصيل الواقعة

-

آخر تطورات الحالة الصحية للطفلة المحقونة بالكلور على يد جدتها في الصف

-

تفاصيل مقتل 8 منقبين عن الذهب برصاص زميلهم في سفاجا (صور)

-

وظائف الأزهر 2026.. الشروط وكيفية التسجيل عبر رابط مباشر

-

شاب يطعن خطيبته وسط الشارع بالمعصرة بعد رغبتها في فسخ الخطوبة

-

سعر الريال السعودي مقابل الجنيه المصري اليوم الجمعة 1 مايو 2026

-

سعر صرف الدينار الكويتي مقابل الجنيه المصري اليوم الجمعة 1 مايو 2026

أخبار ذات صلة

أماكن خروجات في الصيف 2026 على قد الإيد

01 مايو 2026 10:06 م

العثور على جائزة "أوسكار" لمخرج روسي بعد اختفائها في المطار

01 مايو 2026 07:17 م

"فكي البلوك والنبي".. شاب يستعطف خطيبته باكيًا للعودة إليه

01 مايو 2026 04:55 م

دراسة تكشف: 30% من جيل زد يعتقدون امتلاكهم الحاسة السادسة

01 مايو 2026 03:40 م

كيف تقضي أسبوعا لا ينسى في الإسكندرية؟.. خريطة كاملة بالأسعار

01 مايو 2026 02:56 م

منشور غامض لشاب الإسماعيلية قبل إنهاء حياته.. وشقيقته تكشف التفاصيل (خاص)

30 أبريل 2026 10:05 م

احذر تريند قراءة الكف بالـAI.. تسلية بريئة لسرقة البيانات البيومترية

30 أبريل 2026 10:02 م

هل يحل العمل عن بعد مشكلة الطاقة ويخدم البيئة؟

30 أبريل 2026 07:45 م

أكثر الكلمات انتشاراً

-420262716560904.jpg)